作者:全球时_尚热门焦点吧 | 来源:互联网 | 2023-09-23 15:58

接上篇后续配置

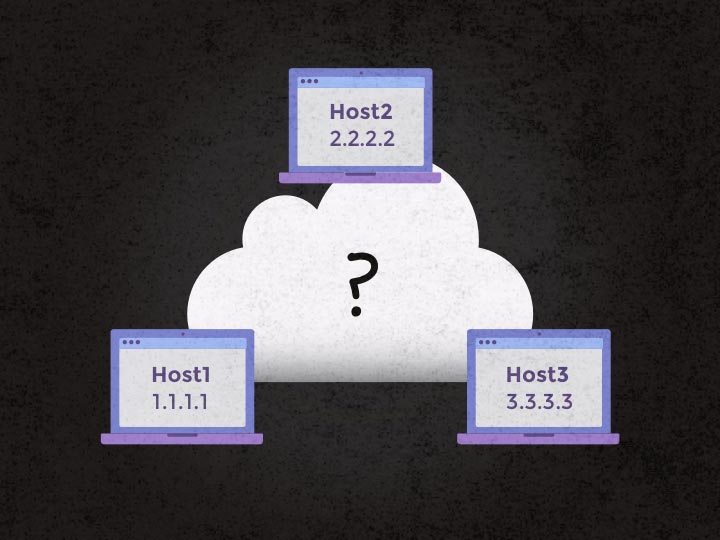

一.配置环境

redhat6.5

server1 172.25.29(50).1 hadoop master nfs

server2 172.25.29(50).2 zookeeper nfs

server3 172.25.29(50).3 zookeeper nfs

server4 172.25.29(50).4 zookeeper nfs

server5 172.25.29(50).5 高可用备机 nfs

使用 nfs 共享同步配置文件,之前配置好java运行环境

二.Hadoop name node节点高可用配置

1.配置Zookeeper 集群,至少三台

2.在各节点启动zookeeper发现服务

3.Hadoop 配置

编辑 hdfs-site.xml 文件:

dfs.nameservices

masters

dfs.ha.namenodes.masters

h1,h2

dfs.namenode.rpc-address.masters.h1

172.25.29.1:9000

dfs.namenode.http-address.masters.h1

172.25.29.1:50070

dfs.namenode.rpc-address.masters.h2

172.25.29.5:9000

dfs.namenode.http-address.masters.h2

172.25.29.5:50070

dfs.namenode.shared.edits.dir

qjournal://172.25.29.2:8485;172.25.29.3:8485;172.25.29.4:8485/masters

dfs.journalnode.edits.dir

/tmp/journaldata

dfs.ha.automatic-failover.enabled

true

dfs.client.failover.proxy.provider.masters

org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvid

er

dfs.ha.fencing.methods

sshfence

shell(/bin/true)

dfs.ha.fencing.ssh.private-key-files

/home/hadoop/.ssh/id_rsa

dfs.ha.fencing.ssh.connect-timeout

30000

4.主机之间设置免密

5.格式化之前删除tmp下的数据,以免影响后面的操作

6.在三个 DN 上依次启动 journalnode(第一次启动 hdfs 必须先启动 journalnode)

7.格式化 HDFS 集群

8.启动 hdfs 集群

9.web登陆172.25.29.1:50070

测试:关闭server1的name node进程,master切换到5上

server1 kill -9 3184

server1宕掉,server5接管

三.Hadoop yarn 的高可用

1.在hadoop/etc/hadoop下编辑 mapred-site.xml 文件

2.在hadoop/etc/hadoop下编辑 yarn-site.xml 文件

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.ha.enabled

true

yarn.resourcemanager.cluster-id

RM_CLUSTER

yarn.resourcemanager.ha.rm-ids

rm1,rm2

yarn.resourcemanager.hostname.rm1

172.25.29.1

yarn.resourcemanager.hostname.rm2

172.25.29.5

yarn.resourcemanager.recovery.enabled

true

yarn.resourcemanager.store.class

org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore value>

yarn.resourcemanager.zk-address

172.25.29.2:2181,172.25.29.3:2181,172.25.29.4:2181

3.启动 yarn 服务

server5 RM2 上需要手动启动

4.测试

在server1上 kill -9 3593 进程,master切换到server5上

四.Hbase 分布式部署

1.hbase 配置

指定 java 目录

指定 hadoop 目录,否则 hbase无法识别 hdfs 集群配置

2.vim hbase-site.xml

hbase.rootdir

hdfs://masters/hbase

hbase.cluster.distributed

true

hbase.zookeeper.quorum

172.25.29.2,172.25.29.3,172.25.29启动 hbase.4

dfs.replication

2

hbase.master

h1

3.启动 hbase

4.备节点手动运行

5.查看配置结果

本文转自一百个小排 51CTO博客,原文链接:http://blog.51cto.com/anfishr/1975957,如需转载请自行联系原作者